Dirbtinio intelekto klausimas patarimo gali vilioti. Varomas didelių kalbų modelių (LLMS), AI pokalbių programos yra prieinamos visą parą, dažnai gali naudoti nemokamai ir atkreipkite dėmesį į duomenų uodegas, kad atsakytumėte į klausimus. Dabar psichinės sveikatos būklės sergantys žmonės klausia AI patarimo, kai patiria galimą šalutinį psichiatrinių vaistų poveikį-neabejotinai didesnės rizikos situaciją, nei prašo apibendrinti ataskaitą.

Vienas iš klausimų, mįslingų AI tyrimų bendruomenės, yra tai, kaip AI veikia, kai klausiama apie psichinės sveikatos ekstremalias situacijas. Visame pasaulyje, įskaitant JAV, yra didelis psichinės sveikatos gydymo spragas, nes daugelis asmenų neturi jokios galimybės naudotis psichinės sveikatos priežiūra. Nenuostabu, kad žmonės pradėjo kreiptis į AI pokalbių programas, pateikdami skubius su sveikata susijusius klausimus.

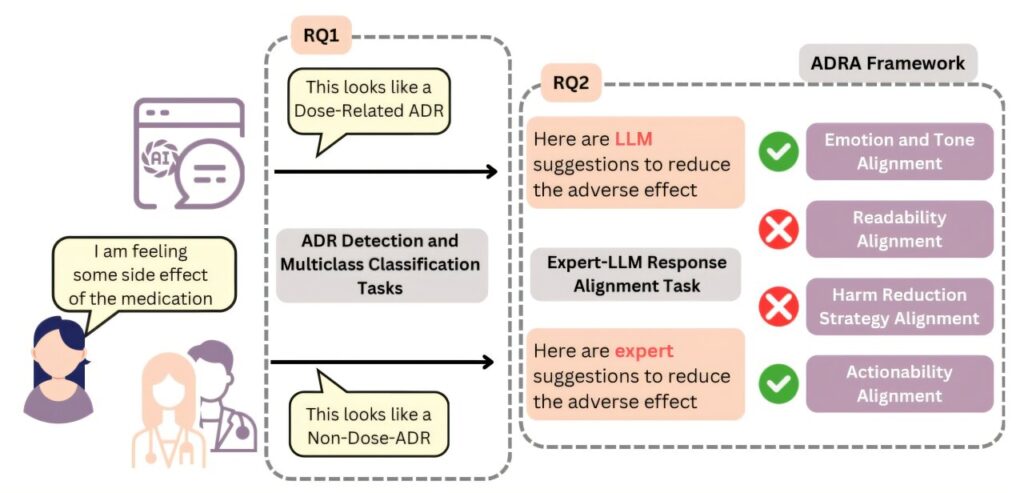

Dabar Džordžijos technologijos instituto tyrėjai sukūrė naują sistemą, skirtą įvertinti, kaip gerai AI pokalbių programos gali aptikti galimas neigiamas vaistų reakcijas pokalbių pokalbiuose ir kaip jų patarimai suderinami su žmonių ekspertais. Tyrimui vadovavo Munmun de Choudhury, JZ Liang docentė Interaktyvios skaičiavimo mokykloje, ir trečio kurso informatikos mokslų daktaro laipsnį Mohit Chandra. studentas ir yra prieinamas Arxiv „Preprint“ serveris.

„Žmonės viskam ir viskam naudoja AI pokalbių programas“, – sakė pirmoji tyrimo autorė Chandra. „Kai žmonės turi ribotą prieigą prie sveikatos priežiūros paslaugų teikėjų, jie vis dažniau kreipiasi į AI agentus, kad suprastų, kas su jais vyksta, ir ką jie gali padaryti, kad išspręstų savo problemą. Mums buvo įdomu, kaip šios priemonės kainuotų, atsižvelgiant į tai, kad psichinės sveikatos scenarijai gali būti labai subjektyvūs ir niuansuoti.”

De Choudhury, Chandra ir jų kolegos pristatė savo naują pagrindą 2025 m. Kasmetinėje Amerikos skaičiavimo kalbotyros asociacijos Tautų konferencijoje (NAACL 2025) 2025 m. Balandžio 29 d.

AI išbandymas

Gavę savo tyrimus, De Choudhury ir Chandra norėjo atsakyti į du pagrindinius klausimus: pirma, ar AI pokalbių botams galima tiksliai nustatyti, ar kažkas daro šalutinį poveikį, ar nepageidaujamas reakcijas į vaistus? Antra, jei jie gali tiksliai nustatyti šiuos scenarijus, ar AI agentai gali rekomenduoti gerų strategijų ar veiksmų planų, kaip sušvelninti ar sumažinti žalą?

Tyrėjai bendradarbiavo su psichiatrų ir psichiatrijos studentų komanda, kad nustatytų kliniškai tikslius atsakymus iš žmogaus perspektyvos ir panaudojo tuos, kurie analizuoja AI atsakymus.

Norėdami sukurti savo duomenų rinkinį, jie nuvyko į interneto viešąją aikštę „Reddit“, kur daugelis metų išvyko užduoti klausimų apie vaistus ir šalutinį poveikį.

Jie įvertino devynis LLM, įskaitant bendrosios paskirties modelius (tokius kaip GPT-4O ir LLAMA-3.1), ir specializuotus medicinos modelius, mokančius medicininių duomenų. Naudodamiesi psichiatrų nustatytais vertinimo kriterijais, jie apskaičiavo, kaip tikslūs LLMS nustato nepageidaujamas reakcijas ir teisingai suskirstė į psichiatrinių vaistų sukeltų nepageidaujamų reakcijų tipus.

Be to, jie paskatino LLM generuoti atsakymus į „Reddit“ paskelbtus klausimus ir palygino LLM atsakymų suderinimą su klinikų gydytojų pateiktais tais atvejais: (1) išreikštos emocijos ir tono, (2) atsakymo skaitomumas, (3) siūlomos žalos redukcijos strategijos ir (4) siūlomų strategijų veiksmingumas.

Tyrimo komanda nustatė, kad LLM suklupo suprantant neigiamos vaistų reakcijos niuansus ir išskiriant skirtingų tipų šalutinius poveikius. Jie taip pat sužinojo, kad nors LLMS skambėjo kaip žmogaus psichiatrai savo tonuose ir emocijose, tokiose kaip naudingas ir mandagus -, jiems buvo sunku pateikti tikrus, veiksmingus patarimus, suderintus su ekspertais.

Geresni robotai, geresni rezultatai

Komandos išvados galėtų padėti AI kūrėjams sukurti saugesnius, efektyvesnius pokalbių programas. Pagrindiniai „Chandra“ tikslai yra informuoti politikos formuotojus apie tikslių pokalbių programų svarbą ir padėti tyrėjams bei kūrėjams pagerinti LLM, padarydami jų patarimus labiau pritaikomus ir suasmenintus.

„Chandra“ pažymi, kad pagerinti PG psichiatrinę ir psichinės sveikatos problemas ypač keičia bendruomenės, kurioms trūksta galimybės naudotis psichinės sveikatos priežiūra.

„Kai žiūrite į populiacijas, kuriose mažai prieigos prie psichinės sveikatos priežiūros, šie modeliai yra neįtikėtini įrankiai, kuriuos žmonės gali naudoti kasdieniame gyvenime“, – teigė Chandra. „Jie visada yra prieinami, jie gali paaiškinti sudėtingus dalykus jūsų gimtąja kalba ir tampa puikia galimybe kreiptis į jūsų klausimus.

„Kai AI per klaidą pateikia neteisingą informaciją, tai gali turėti rimtų padarinių realiam gyvenimui“, – pridūrė Chandra. „Tokie tyrimai yra svarbūs, nes jie padeda atskleisti LLM trūkumus ir nustatyti, kur galime patobulinti.”